Đặt vấn đề

Việc đơn giản hóa ngôn ngữ cho những người suy giảm nhận thức không chỉ là một yêu cầu cần phải tuân thủ hay một lựa chọn phong cách, mà là một quyết định thiết kế mang tính đạo đức và có trách nhiệm. Điều này càng quan trọng hơn khi chúng ta sử dụng AI tạo sinh để chỉnh sửa các tài liệu phức tạp.

Ví dụ, việc xử lý và diễn giải những phản hồi của bình duyệt viên có thể cực kỳ khó khăn nếu không có sự hỗ trợ từ AI, bởi chúng thường rất dày đặc thông tin, mang nặng chuyên môn và gắn liền với bối cảnh cụ thể. Nhưng chuyện gì sẽ xảy ra nếu các công cụ tóm tắt này lại bóp méo ý nghĩa ban đầu của người phản biện?

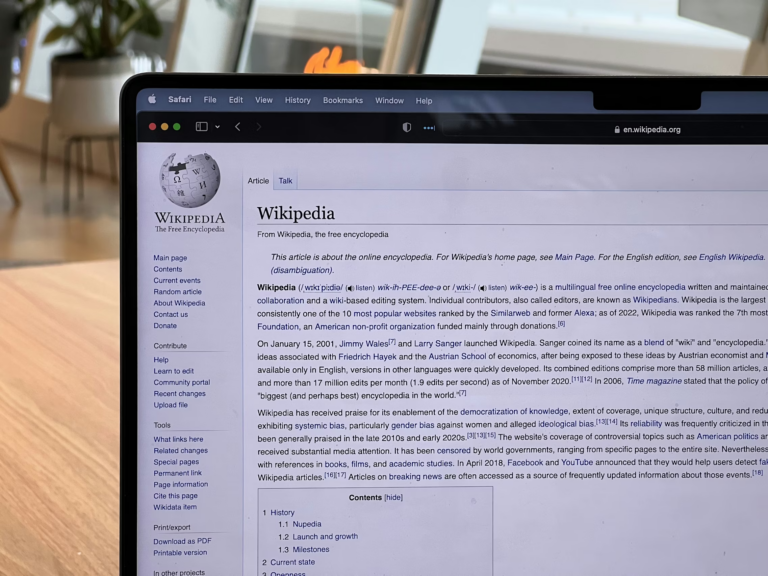

Nghiên cứu gần đây của tôi đã tìm hiểu câu hỏi này qua một thí nghiệm: sử dụng AI để cải thiện khả năng tiếp cận các bình luận của người phản biện. Những gì tôi khám phá ra mang một hàm ý quan trọng đối với toàn bộ cộng đồng truyền thông và xuất bản học thuật. Tôi đã đánh giá khả năng của GPT-4 trong việc tóm tắt phản hồi của phản biện học thuật trong lĩnh vực tài chính. Lĩnh vực này được chọn không chỉ vì có nhiều từ ngữ chuyên ngành mà còn vì có các khái niệm như quan hệ nhân quả, mô hình rủi ro hay tính nội sinh đòi hỏi sự phân tích cụ thể. Trong bối cảnh này, chỉ một thay đổi nhỏ về từ ngữ cũng có thể làm sai lệch ý nghĩa hoặc phá vỡ dụng ý của người phản biện. Với nền tảng kiến thức tài chính của mình, tôi xem đây là một thí nghiệm lý tưởng để xem AI có thể đơn giản hóa mà vẫn giữ được sự rõ ràng và tính toàn vẹn của các khái niệm hay không. Tôi khuyến khích các nhà nghiên cứu ở lĩnh vực khác cũng thực hiện những thí nghiệm tương tự, bởi bối cảnh và mức độ nghiêm trọng có thể khác nhau, nhưng thách thức về khả năng tiếp cận thì vẫn luôn hiện hữu. Để đảm bảo tính minh bạch và khả năng tái lập, tôi đã công khai bản ghi chép các cuộc hội thoại với GPT trong bài báo của mình.

Phương pháp tiến hành

Tôi đã yêu cầu mô hình AI viết lại các bình luận— một lần với yêu cầu chỉ đơn giản hóa ngôn ngữ và một lần yêu cầu chúng chú ý đến việc tiếp cận nhận thức. Mục đích là để xem liệu nó có thể giữ nguyên ý chính mà vẫn cải thiện khả năng đọc hiểu hay không. Tôi chọn 10 báo cáo phản biện có các từ ngữ chuyên ngành phức tạp và chạy mỗi tình huống hai lần. Cách làm này không chỉ giúp đánh giá chất lượng tóm tắt mà còn kiểm tra tính nhất quán của kết quả.

Kết quả cho thấy AI thường hiểu sai các bình luận, không phải vì bản tóm tắt thiếu rõ ràng mà vì chúng đã bị mất đi ý nghĩa cốt lõi. Các bản tóm tắt do GPT tạo ra thường làm thay đổi cách hiểu của các thuật ngữ, bỏ qua sắc thái phương pháp luận và gây ra sự thiếu nhất quán về ngữ nghĩa. Điều này đặt ra lo ngại nghiêm trọng về độ tin cậy của AI trong các bối cảnh liên quan đến khả năng tiếp cận, đặc biệt khi mục tiêu không chỉ là giúp người dùng hiểu mà còn đảm bảo họ có thể tham gia bình đẳng vào các cuộc đối thoại học thuật.

Kết quả

Hãy xem xét một ví dụ cụ thể: một phản hồi của phản biện về việc sử dụng phương pháp difference-in-differences (khác biệt trong khác biệt) để giải thích thời điểm và mức độ phản ứng của thị trường đối với các thông báo của ngân hàng trung ương. Ở bản tóm tắt của GPT-4, thay vì tập trung vào lý do “tại sao thị trường phản ứng như vậy,” nó lại viết thành “thị trường phản ứng nhanh và mạnh thế nào.” Cách diễn đạt lại này đã làm giảm trọng tâm từ một khuyến nghị về phương pháp luận thành một nhận xét chung chung, hoàn toàn loại bỏ mục đích ban đầu của phương pháp được sử dụng.

Trong một trường hợp khác, AI lại mô tả “tính nội sinh” (endogeneity) là “tác động ẩn” (hidden effects) Mặc dù nghe có vẻ dễ hiểu hơn, nhưng nó lại làm mất đi ý nghĩa kỹ thuật của thuật ngữ. Tính nội sinh không chỉ là những yếu tố “ẩn” — nó đề cập đến tình huống khi một biến giải thích bị sai lệch về mặt thống kê, đòi hỏi các phương pháp để điều chỉnh. Một định nghĩa chính xác hơn có thể là: “Khi một yếu tố trong mô hình ảnh hưởng cả nguyên nhân và kết quả, khiến việc xác định điều gì thực sự gây ra kết quả trở nên khó khăn.” Việc đơn giản hóa quá mức như vậy có thể khiến người đọc bỏ qua những lỗi nghiêm trọng trong thiết kế nghiên cứu.

Mô hình cũng gặp vấn đề với các thuật ngữ mang tính trừu tượng. Nó đã thay cụm “bounded rationality” thành “limited thinking ability (khả năng suy nghĩ hạn chế),” một cụm từ không chỉ sai nghĩa mà còn có nguy cơ gây xúc phạm. “Bounded rationality” đề cập đến việc ra quyết định dưới các điều kiện bị giới hạn (ví dụ như thiếu thông tin hoặc bị áp lực thời gian), chứ không phải là khiếm khuyết về nhận thức. Trong thiết kế nội dung phục vụ khả năng tiếp cận, chúng ta được dạy phải tôn trọng phẩm giá và sự chính xác; nhưng GPT-4 đã thất bại ở cả hai điểm này.

Ngay cả khả năng tiếp cận thị giác cũng bị ảnh hưởng. Chẳng hạn, một nhận xét từ một phản biện viên về việc chú giải trong biểu đồ hồi quy khó đọc đã được AI đơn giản hóa ngắn gọn thành “nhãn khó đọc.” Mặc dù đúng, cách diễn đạt này lại bỏ qua bối cảnh quan trọng: đó là lý do tại sao các chú giải lại cần thiết, cụ thể là vai trò của chúng trong việc diễn giải tác động theo nhóm trong dữ liệu thu nhập. Với những người chỉ dựa vào các tóm tắt để chỉnh sửa bản thảo, việc mất đi hàm ý trong phản biện ban đầu sẽ có ảnh hưởng không nhỏ.

Sự thiếu nhất quán cũng là một vấn đề đáng lo ngại. Ở một bản, AI giữ lại thuật ngữ “phân tích độ nhạy” (sensitivity analysis) mà không giải thích; ở bản khác, nó lại thay bằng một phép ẩn dụ mơ hồ như “kiểm tra lại phương pháp” (double-checking your methods). Sự thay đổi này không chỉ đơn thuần là về phong cách mà còn làm thay đổi ý nghĩa cốt lõi của bình luận.

Những kết quả này cho thấy một mâu thuẫn cơ bản khi sử dụng AI để đơn giản hóa nội dung: nỗ lực làm cho văn bản rõ ràng hơn lại có thể vô tình làm mờ đi logic nền tảng của khái niệm. Đây là một sự đánh đổi không thể chấp nhận được trong thiết kế lấy khả năng tiếp cận làm trọng tâm.

Hàm ý và khuyến nghị

Các mô hình ngôn ngữ lớn như GPT-4 không “hiểu” ý định hay chức năng của một nhận xét theo cách con người làm. Thay vào đó, chúng dự đoán cách diễn đạt dựa trên các mô hình thống kê trong ngôn ngữ. Vì vậy, chúng thường bỏ lỡ “lý do tại sao” của các bình luận phản biện, đặc biệt là trong bối cảnh sự chính xác và tính logic được đề cao. Trong bối cảnh việc đơn giản hóa và tóm tắt phải được thực hiện cẩn trọng và tôn trọng quyền tự chủ của người dùng, những sai sót này mang tính hệ thống chứ không phải ngẫu nhiên.

Vậy, các nhà xuất bản, lập trình viên phần mềm và chuyên gia AI có thể rút ra những bài học gì?

- Thiết kế prompt để cho AI giữ nguyên các khái niệm chuyên ngành.

- Việc xác minh là cần thiết — mỗi bản đơn giản hóa từ AI phải được rà soát để đảm bảo tính chính xác và tôn trọng về mặt nhận thức.

- Cần điều chỉnh tốt hơn giữa quá trình huấn luyện LLM và mục tiêu khả năng tiếp cận, không chỉ về phong cách ngôn ngữ mà còn chịu trách nhiệm về khái niệm mà nó đưa ra.

- Thiết kế vì sự hòa nhập nghĩa là đảm bảo mọi người nhận được đúng thông điệp, chứ không chỉ là một thông điệp “dễ đọc”.

Một hướng đi khả thi là phát triển các công cụ AI được tinh chỉnh cho nội dung học thuật theo từng lĩnh vực. Điều này sẽ giúp việc đơn giản hóa vẫn giữ được tính toàn vẹn của khái niệm. Giai đoạn đầu có thể bao gồm việc thu thập phản hồi từ các biên tập viên hoặc chuyên gia về khả năng tiếp cận, giúp công cụ cải thiện độ chính xác ngữ nghĩa theo thời gian.

Ngoài ra, những cải tiến ở cấp độ giao diện cũng rất quan trọng. Ví dụ, cho phép người phản biện hoặc biên tập viên gắn nhãn mục đích của nhận xét (như “phương pháp,” “cấu trúc,” hay “ngôn ngữ”) có thể giúp AI hiểu rõ hơn lý do tồn tại của phản hồi, từ đó đơn giản hóa một cách thông minh hơn.

Nếu chúng ta muốn khả năng tiếp cận thực sự mang lại sự công bằng — chứ không phải làm mất đi ý nghĩa — thì đây là những hướng đi mà các nhà chiến lược nội dung, nhà vận động vì khả năng tiếp cận và nhà phát triển AI cần nghiêm túc xem xét.

Dịch từ Scholarly Kitchen

--- Bài viết này có hữu ích không? ---

Nhấn sao để đánh giá!

Đánh giá trung bình 0 / 5. Số đánh giá: 0

Chưa có đánh giá.